InternVL3.5是什么

InternVL3.5(书生·万象3.5)是上海人工智能实验室开源的多模态大模型,模型在通用能力、推理能力和部署效率上全面升级,提供从10亿到2410亿参数的九种尺寸版本,覆盖不同资源需求场景,包含稠密模型和专家混合模型(MoE),是首个支持GPT-OSS语言模型基座的开源多模态大模型。InternVL3.5 采用级联式强化学习(Cascade RL)框架,通过“离线预热-在线精调”两阶段流程,显著提升推理能力。旗舰模型 InternVL3.5-241B-A28B 在多学科推理基准 MMMU 中获得开源模型最高分77.7分,超越 GPT-5。借助动态视觉分辨率路由(ViR)和解耦部署框架(DvD),模型在高分辨率输入下的响应速度大幅提升,38B 模型的吞吐量提升达4.05倍。

InternVL3.5的主要功能

-

多模态感知:在图像、视频问答等多模态感知任务中表现出色,241B-A28B 模型以 74.1 的平均得分超越现有开源模型,接近商业模型 GPT-5(74.0)。

-

多模态推理:在多学科推理基准 MMMU 中获得 77.7 分,较前代提升超 5 个百分点,位列开源榜首。

-

文本能力:在 AIME、GPQA 及 IFEval 等多个基准中,模型可以取得 85.3 的均分,处于开源领先。

-

GUI 智能体:强化了 GUI 智能体能力,可实现跨平台自动化操作,例如在 ScreenSpot GUI 定位任务中以 92.9 分超越主流开源模型。

-

具身空间推理:具备更强的 grounding 能力,可以泛化到全新的复杂具身场景,支持可泛化的长程物体抓取操作。

-

矢量图形处理:在 SGP-Bench 以 70.7 分刷新开源纪录,能够有效应用于网页图形生成与工程图纸解析等专业场景。

InternVL3.5的技术原理

-

级联式强化学习(Cascade RL):通过“离线预热-在线精调”两阶段流程,离线阶段使用混合偏好优化(MPO)算法快速提升基础推理能力,为后续训练提供高质量样本;在线阶段基于 GSPO 算法,以模型自身生成的样本为基础,动态调整输出分布,显著提升训练稳定性和推理性能。

-

动态视觉分辨率路由(ViR):为每个图像切片动态选择压缩率,在语义密集区域保留高分辨率,背景区域自适应压缩,减少视觉 tokens,显著提升推理速度,同时几乎不损失性能。

-

解耦部署框架(DvD):将视觉编码器与语言模型分置于不同 GPU,结合 BF16 精度特征传输与异步流水线设计,使视觉计算与语言生成并行执行,大幅提升吞吐量,解决传统串行部署的资源阻塞问题。

-

全量级模型优化:提供从 10 亿到 2410 亿参数的九种尺寸模型,覆盖不同资源需求场景,包含稠密模型和专家混合模型(MoE),首个支持 GPT-OSS 语言模型基座的开源多模态大模型,满足多样化应用需求。

-

多模态协同推理:通过融合视觉与语言等多维信息,实现多模态任务的高效处理,提升模型在复杂任务中的推理能力,推动多模态技术从“理解”到“行动”的跨越。

InternVL3.5的项目地址

- Github仓库:https://github.com/OpenGVLab/InternVL

- HuggingFace模型地址:https://huggingface.co/OpenGVLab/InternVL3_5-241B-A28B

- 技术报告:https://huggingface.co/papers/2508.18265

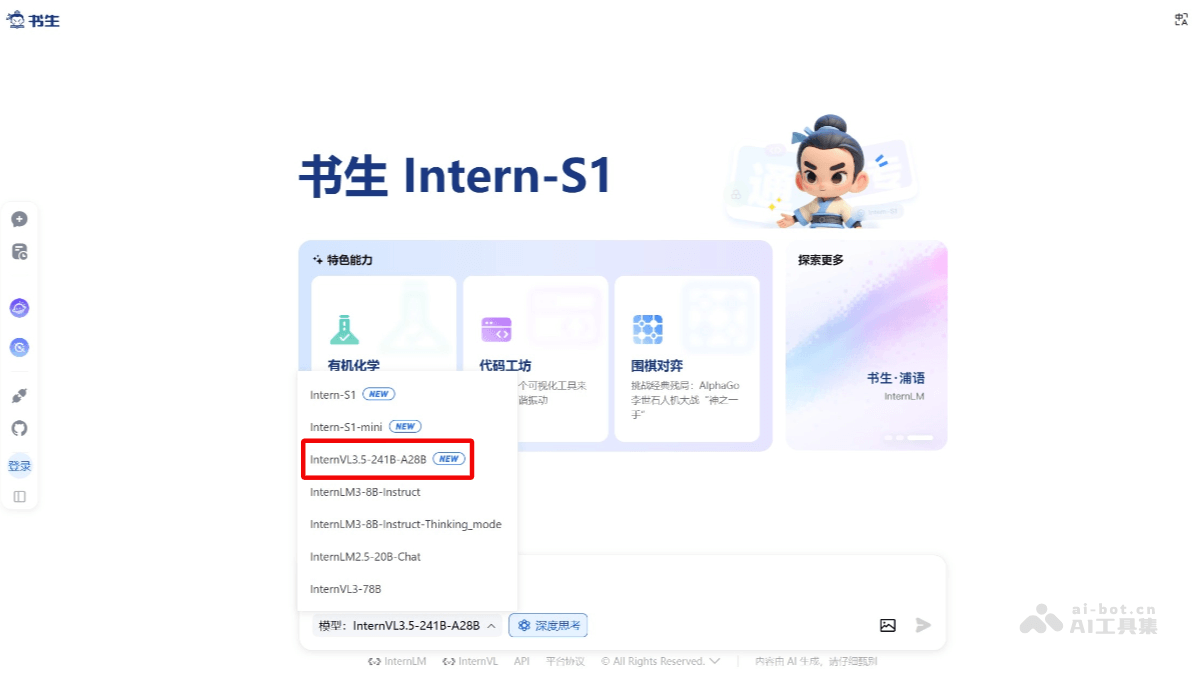

- 在线体验地址:书生大模型

InternVL3.5的应用场景

-

办公自动化:通过 GUI 智能体功能,实现跨平台的自动化办公操作,如自动处理 Excel 数据录入、PPT 设计排版、邮件发送等任务,提高工作效率。

-

智能家居控制:利用具身空间推理能力,辅助机器人在家庭环境中完成物品定位、路径规划和物理交互任务,例如智能清洁机器人根据环境布局自主规划清洁路径。

-

教育辅导:在多模态推理和文本能力的支持下,为学生提供个性化的学习辅导,解答复杂的学科问题,如数学物理题解、逻辑推理训练等,提升学习效果。

-

内容创作:借助通用多模态感知能力,自动生成图像描述、视频字幕等,帮助创作者快速生成创意内容,提高内容创作的效率和质量。

-

网页设计与图形生成:利用矢量图形处理能力,根据用户指令生成或编辑 SVG 矢量图形,适用于网页设计、图标制作等,提升设计效率和个性化体验。