MagicTryOn是什么

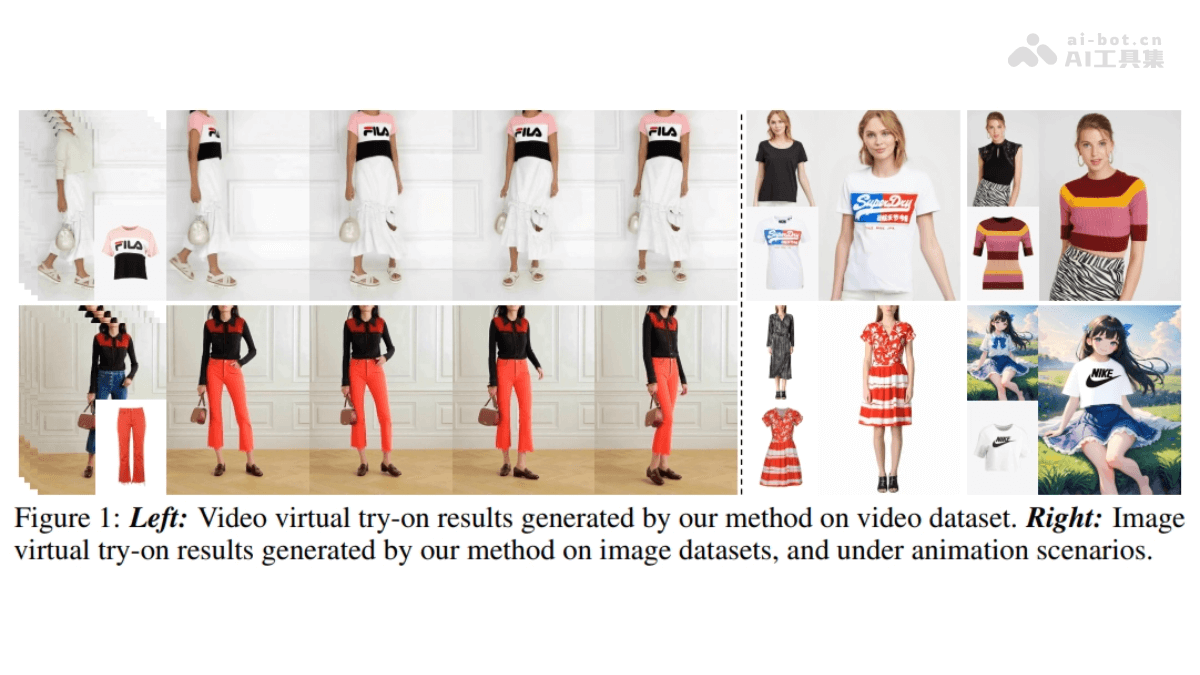

MagicTryOn是浙江大学计算机科学与技术学院、vivo移动通信等机构推出的基于视频扩散Transformer的视频虚拟试穿框架。框架替换传统的U-Net架构为更具表现力的扩散Transformer(DiT),结合全自注意力机制,实现视频的时空一致性建模。框架用粗到细的服装保持策略,基于在嵌入阶段整合服装标记以及在去噪阶段引入语义、纹理和轮廓线等多条件,有效保留服装细节。MagicTryOn在图像和视频试穿数据集上均展现出超越现有最先进方法的性能,在评估指标、视觉质量和在野外场景的泛化能力上都表现出色。

MagicTryOn的主要功能

- 服装细节保留:精确模拟服装的纹理、图案和轮廓,在人物运动时保持真实感和稳定性。

- 时空一致性建模:确保视频中各帧之间的连贯性,避免服装闪烁和抖动,提供流畅的试穿体验。

- 多条件引导:基于文本、图像特征、服装标记和轮廓线标记等多种条件,生成更真实、更细致的试穿效果。

MagicTryOn的技术原理

- 扩散Transformer(DiT)架构:DiT的模块化设计允许更灵活地注入条件信息,让多级服装特征能有效地整合到去噪过程中。DiT内置的全自注意力机制能联合建模视频的时空一致性,捕捉帧内局部细节和帧间动态变化。

-

粗到细的服装保持策略:

- 粗策略:在嵌入阶段,将服装标记(garment tokens)注入输入标记序列,扩展旋转位置编码(RoPE)的网格大小,让服装标记和输入标记能共享一致的位置编码。

- 细策略:在去噪阶段,引入语义引导交叉注意力(SGCA)和特征引导交叉注意力(FGCA)模块,提供细粒度的服装细节引导。SGCA用文本标记和CLIP图像标记作为输入,提供服装的全局语义表示;FGCA结合服装标记和轮廓线标记,进一步注入详细的局部信息。

- 掩码感知损失(Mask-Aware Loss):基于引入掩码感知损失,模型能更专注于服装区域的生成,提高服装区域的细节保真度和整体合成结果的真实感。

- 时空一致性建模:基于全自注意力机制联合建模视频的时空一致性,避免传统方法中空间和时间信息分别建模的局限性。

MagicTryOn的项目地址

- 项目官网:https://vivocameraresearch.github.io/magictryon/

- GitHub仓库:https://github.com/vivoCameraResearch/Magic-TryOn/

- arXiv技术论文:https://arxiv.org/pdf/2505.21325

MagicTryOn的应用场景

- 在线购物:用户在线试穿不同服装,提升购物体验。

- 时尚设计:设计师快速预览服装效果,加速设计流程。

- 虚拟试衣间:为实体店提供虚拟试衣服务,减少实体试衣间的使用。

- 广告与营销:品牌制作个性化试穿广告,吸引消费者。

- 游戏与娱乐:在游戏中实时试穿虚拟服装,增强沉浸感。